在科研人员异质数据上可迁移预训练模型的研究中,大数据部提出了一种基于多任务自监督学习的科研人员数据预训练模型RPT,该模型能有效地迁移到多个科研人员数据挖掘和分析任务,以提高学术服务的质量和智能。研究成果发表在国际期刊IEEE Transactions on Big Data上。研究成果相关论文第一作者为大数据部博士生乔子越,导师为周园春研究员。

随着学术搜索引擎的发展,海量研究者数据的挖掘和分析需求,如科研人员关系抽取和专家发现,已变得尤为重要。它可以提高服务质量和学术引擎的智能。现有的研究大多集中于针对特定应用场景的单个任务,并学习特定于任务的模型,通常无法迁移到其它任务。预训练技术提供了一个高效的共享模型思路,可以从大量未标记的数据中获取有价值的信息,并迁移到多种下游挖掘分析任务中。

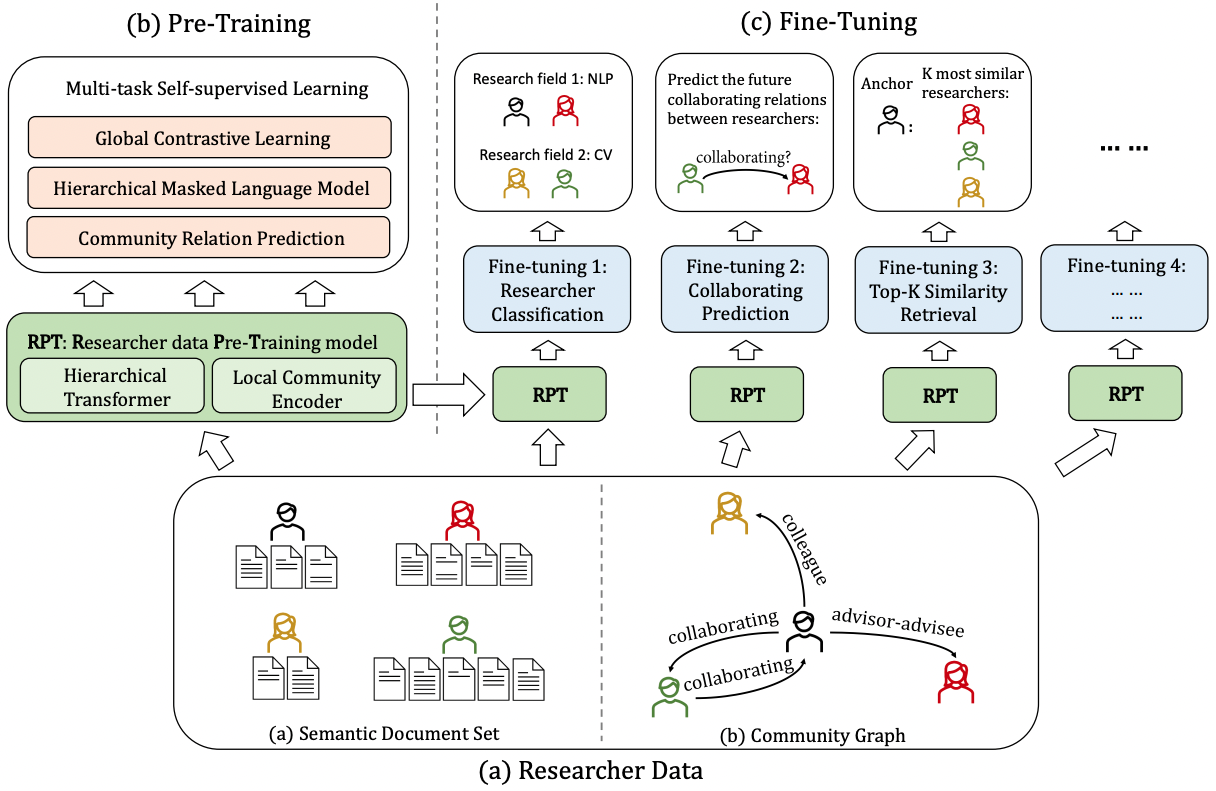

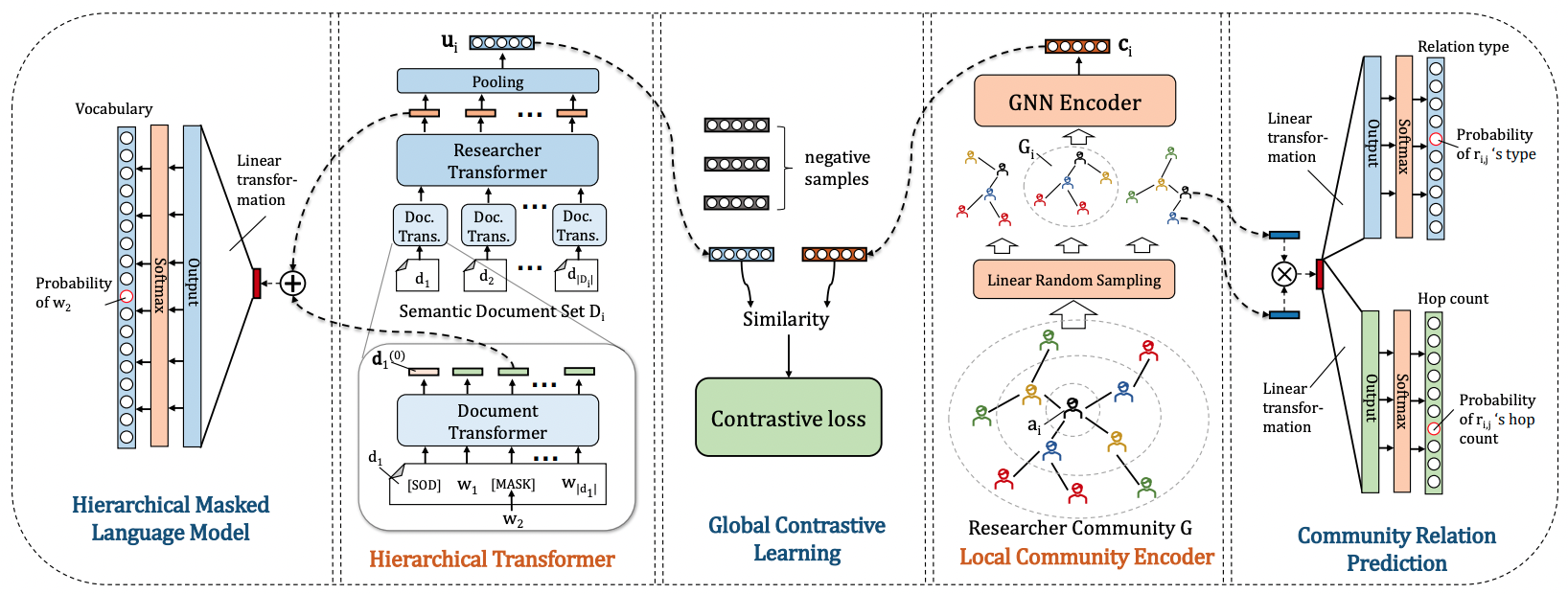

基于此,该研究从模型在异质数据上的泛化能力,可迁移性和可扩展性出发,提出了一种基于多任务自监督学习的科研人员数据预训练模型RPT。具体来说,将科研人员的数据分为语义文档集和社区网络。并设计了层次Transformer的语义编码器和基于GNN的局部社区编码器,分别从这两类数据中捕获信息。然后,RPT通过三个自监督学习目标来训练整个模型,包含了一个基于对比学习的融合两种信息的主任务,和两个辅助任务,即分别用于提取语义和社区信息的分层掩蔽语言模型和社区关系预测模型,以提升细粒度上的预训练水平。RPT有两种迁移模式,用于在不同场景下进行微调。该研究进行了大量实验来评估RPT,多个下游任务的结果验证了科研人员数据预训练的有效性。(撰稿:乔子越)

相关成果:Ziyue Qiao, Yanjie Fu, Pengyang Wang, Meng Xiao, Zhiyuan Ning, Yi Du, Yuanchun Zhou. RPT: Toward Transferable Model on Heterogeneous Researcher Data via Pre-Training. IEEE Transactions on Big Data. 2022

图1 针对科研人员异质数据的预训练和微调框架

图2 论文提出的科研人员数据的预训练模型图